一夜之间跌去2000亿美元!NVIDIA怎么了

无论AI需求是否强劲,“铲子卖家”都是最先感受到市场温度的。随着云厂商资本支出上升引发的“AI泡沫论”越来越盛行,英伟达迎来了最受关注的财报季。

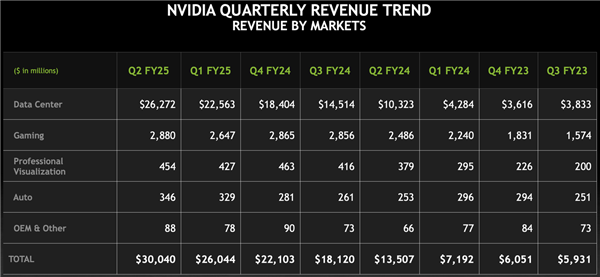

当地时间周三收盘后,NVIDIA公布了2025财年Q2财务业绩。营收创历史新高——300亿美元,同比增长122%。其中,数据中心业务也破纪录地达到263亿美元。尽管如此,NVIDIA当日股价持续走低,财报电话会后,该公司股价下跌6.6%。究其原因,NVIDIA数据中心的环比增长显著放缓,该季度环比只有16%。这表明云厂商等大客户后续的资本支出能否支撑NVIDIA的高增长数据中心。没有把握。

在电话会议中,当被问及如何看待人工智能资本支出的ROI(投资回报率)时,黄仁勋表示:“投资NVIDIA基础设施的人可以立即获得回报。投资计算基础设施是当今最好的投资。回报率项目。”

言外之意,ChatGPT引发的大模型变革近两年后,确定性的AI机会,仍然只在基础设施层面,这着实考验投资者耐心。NVIDIA的财报给AI半导体圈带来了不小的震动。伴随英伟达股价下跌,上下游AI半导体行业股价也纷纷下跌。

与此同时,戴尔股价下跌3%,超微股价下跌4%。 Broadcom和AMD的股价下跌约2%。美光科技股价下跌2.6%。芯片设计公司Arm Holdings的股价下跌近3%。

Blackwell推迟出货截至2024年7月28日的第二季度,NVIDIA总营收为300亿美元,较第一季度增长15%,较去年同期增长122%。

其中,盈利最多的数据中心业务同比增长154%,达到263亿美元。

NVIDIA ACFO Colette Kress解释说,数据中心的强劲增长是由Hopper GPU计算平台的需求推动的,该平台用于训练和推断大型语言模型、推荐算法引擎以及生成人工智能应用程序。

NVIDIA H200平台从本季度开始量产,向大型云厂商(CSP)、消费者互联网和企业公司供货。与H100相比,H200内存带宽提升了40%以上。

除了大型模型相关的使用场景外,NVIDIA数据中心的主要使用场景还包括:使用CUDA和AI工作负载对视频、图像和文本数据进行预处理和后处理;合成数据生成; SQL 和Vector 数据库处理。

对于这些计算场景带来的收入,NVIDIA表示,采用这种新架构的Hopper架构的需求仍旧强劲,并预计2025财年下半年出货量将继续增加。同时客户对下一代Blackwell架构的计算单元,需求远超过供给。芯片实际上应该在本财季批量出货。上个季度,老黄表示Blackwell将在Q2财季开始出货,Q3增加出货量,并将在本财年看到“Blackwell架构带来的大量营收”。

但本月早些时候,The Information 爆料称NVIDIA 下一代计算平台Blackwell GPU 的发货将被推迟。

对此,NVIDIA首席财务官Colette Kress表示:“我们对BlackwellGPU掩模(mask)进行了更改,以提高产量。Blackwell的量产计划于第四季度开始,预计第四财季Blackwell营收将达到数十亿美元。”半导体中的掩模是设计和制造过程中的关键部分。它被视为集成电路设计的模板。更换是一个昂贵且耗时的过程。这似乎是导致Nvidia 略微推迟Blackwell 大批量出货的原因。

值得注意的是,NVIDIA的计算平台集成了处理器、互连、软件、算法、系统和服务。因此,数据中心业务的同比增长主要由计算和网络收入构成。

网络收入方面,在InfiniBand和以太网(包括Spectrum-X端到端以太网平台)的推动下,本季度NVIDIA数据中心网络收入为37亿美元,同比增长114%。

Kress表示,“AI以太网收入不断翻倍,数百家客户采用了以太网产品,其中包括马斯克的X.ai。这对我们来说是一个全新的产品,它正在成为一项为人工智能带来数十亿美元业务的技术。” ”

在数据中心性能方面,NVIDIA还特别提到了中国市场的力量。克雷斯表示,第二财季英伟达在中国的数据中心收入环比增长,是其数据中心收入的重要贡献者,但其收入占比仍低于出口管制实施前。

除了数据中心业务外,NVIDIA的其他三个业务部门:游戏、专业可视化和汽车收入也出现了不同程度的增长。

其中,游戏收入同比增长16%,环比增长9%。这些增长受GeForce RTX 40系列GPU和游戏机SOC销量的增加。NVIDIA表示,“作为返校季的一部分,第二季度游戏GPU的需求强劲”。

专业可视化收入同比增长20%,汽车收入同比增长37%。后者由人工智能座舱解决方案和自动驾驶平台驱动。

终端AI软件应用尚未盈利,数据中心的牵引力还可以持续多久随着近期科技股的“死亡凝视”,外界希望从英伟达的财报中看到,云厂商和其他客户的支出已经能够获得足够的回报,哪怕能看到收益的迹象回报让客户有信心继续投资NVIDIA 的AI 硬件。

但显然,不仅这份财报没有体现出来,黄和他的CFOKress在电话会议上给予的安慰也未能安抚所有人。

过去一年,随着数据中心业务的暴增,NVIDIA的营收跟着翻了数倍。然而,数据中心的环比增速已经连续四个季度放缓,2025财年Q2的营收只比第一季度增长了16.3%。一年前(2024财年Q2),NVIDIA数据中心营收环比增加140%。这正是这份财报背后的隐忧。NVIDIA 表示,云供应商以及消费互联网(ToC) 和工业互联网(ToB) 公司推动了数据中心的增长。其中,云服务提供商(CSP)约占数据中心收入的45%,消费互联网和工业互联网公司贡献超过50%的收入。

在财报电话会议上,老黄细分了这些数据背后的使用分布。除了云厂商等企业租用算力的场景外,消费互联网上的AI应用目前主要应用于推荐算法系统、广告系统和搜索场景。 “从本季度开始起航”的工业互联网仅列出了ServiceNow、SAP等几大SaaS客户的AI辅助场景。

B端、C端都没有出现暴利的、或者可以规模化的AI应用。既然如此,老黄只能继续教育大家,为什么英伟达的数据中心业务开辟了万亿美元的大市场。

首先,对于大型模型厂商来说,ScalingLaw仍然是唯一有效的规则。在这种情况下,每当模型的大小增加一倍时,数据集的大小也必须增加一倍以上才能对其进行训练。因此,创建模型所需的失败次数呈二次方增加。所以下一代模型需要比上一代多10、20、40倍的计算量。算力指数持续上升的趋势。

与此同时,老黄兜售的“主权人工智能”,在国界内部署自己的人工智能需求,今年将为英伟达带来数十亿美元的收入。

最后,“加速计算”和“生成式AI”是数据中心业务的绝对驱动力,这是万亿美元数据中心市场的“第一原则”。

过去,数据中心没有GPU,只有CPU。未来,每个数据中心都将配备GPU,因为我们需要加速工作负载以“降低成本并提高效率”。另一方面,我们需要GPU 来开启生成式人工智能的新时代。

看到这里,你甚至觉得这些话很熟悉,没错,是老黄在任何公开场合都会科普的“愿景”。经历过那么多个风口,老黄太知道计算的未来了,也太知道要如何把这些未来讲给大家了。只是,这次季报未能等来“耐心资本”。